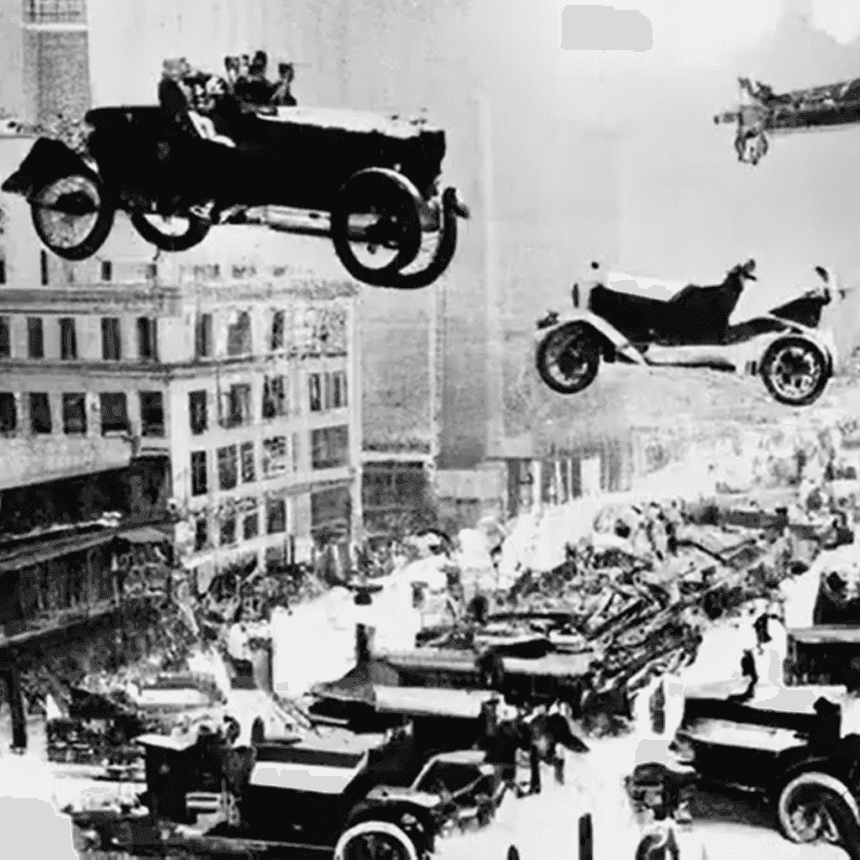

Šta bi bilo da je Slobodan Milošević izgubio izbore 1990. ili da Zoran Đinđić nije ubijen 2003? Chatbot Alternate History može da odgovori na ova pitanja – nudeći potencijalne verzije istorije koja se nikad nije desila. Ovaj chatbot je samo delić nepregledne ponude alt history sadržaja onlajn, koji postaju sve ubedljiviji, kvalitetnije producirani i realniji – zahvaljujući veštačkoj inteligenciji. Tako, recimo, YouTube adresa Epentibi, koju prati više desetina hiljada pretplatnika, koristeći AI kreira lažne dokumentarne filmove, vesti i druge video-sadržaje u kojima se pojavljuju poznati, stvarni likovi u veštački generisanim emisijama koje verno podsećaju na originalne.

Promišljanje alternativnih istorijskih događaja nije novo – od filmova i serija do književnosti. Ono što fenomen razlikuje od svega prethodnog je vizuelna verodostojnost sadržaja proizvedenih upotrebom AI alata i mogućnost da stignu do globalne publike koja često neće moći da razlikuje istinu od fikcije. U pravim rukama, ovi alati mogu poboljšati ljudsku kreativnost i genijalnost. U pogrešnim, oni mogu da iskrive istinu i, slučajno ili namerno, zbune, radikalizuju ili obmanu gledaoce.

Alt history sadržaji postaju sve ubedljiviji

Na nešto slično upozorava nedavni izveštaj UNESCO-a „AI and the Holocaust – Rewriting history“ – u njemu se upozorava da bi veštačka inteligencija mogla da utiče na istorijske zvanične evidencije o Holokaustu i podstakne antisemitizam, ukoliko se hitno u onlajn okruženju ne primene etički principi vezani za korišćenje novih tehnologija. Izveštaj navodi da generativna veštačka inteligencija može ne samo da omogući zlonamernim akterima da šire dezinformacije i narative podstaknute mržnjom, već i nenamerno da izmisli lažan ili obmanjujući sadržaj, kojim bi se moglo sugerisati čak i da se Holokaust nikada nije dogodio.

U procesima stvaranja manipulativnih, obmanjujućih istorijskih sadržaja upotrebom AI UNESCO ističe glavne probleme: AI generisan sadržaj može da izmisli „činjenice“ o Holokaustu, deepfake tehnologija može falsifikovati istorijske dokaze i algoritamska pristrasnost može proširiti poricanje Holokausta. Sve ovo kreira trend preteranog pojednostavljivanja kompleksnih i traumatičnih istorijskih događaja kada modeli AI privileguju uski raspon izvora iz kojih su „učili“ i mali izbor događaja na kojima grade svoje „znanje“. Posledice su krupne jer vode širokom nerazumevanju prošlosti i jačanju stereotipa i predrasuda zasnovanih na govoru mržnje, netoleranciji i – neznanju.

Verzije istorije koje se nikada nisu dogodile

Ove tvrdnje ojačavaju primeri koji pokazuju da kada generativni AI modeli ne raspolažu dovoljnom količinom informacija počinju da izmišljaju događaje, ličnosti, pa i istorijske fenomene – UNESCO navodi slučajeve kada su ChatGPT i Google Bard proizveli sadržaj koji detaljno opisuje događaje vezane za Holokaust koji se nikada nisu dogodili.

Takođe se navode primeri upotrebe AI modela koji stvaraju izmišljena svedočenja, pa čak i menjaju istorijske zapise. Deepfake slike i audio-sadržaj kreiran korišćenjem generativne AI posebno su ubedljivi, dok se aplikacija Historical Figures apostrofira kao posebno notorna jer je korisnicima omogućavala da „razgovaraju“ sa nacističkim vođama kao što su Adolf Hitler i Jozef Gebels (u međuvremenu su obojica uklonjeni sa aplikacije).

Generativni sistemi AI posebno su skloni da podstaknu već postojeće antisemitske predrasude. Bez budnosti, sistemima veštačke inteligencije može se lako manipulisati kako bi uključili podatke sa ekstremnih delova interneta koji promovišu teorije zavere i obmanjujuće tvrdnje. Tako za jedan deo publike izmišljena, alternativna istorija, postaje osnov za stavove i vrednosti na osnovu kojih oblikuju svoj odnos prema sadašnjosti.

Izvor: Radar / Ana Martinoli

Foto: YouTube printscreen